DPIA (Data Protection Impact Assessment, Ocena Skutków dla Ochrony Danych) to obowiązkowy dokument dla firm używających AI w określonych kontekstach. Od 2026 roku, z wejściem w życie AI Act, liczba przypadków wymagających DPIA rośnie — a kary za ich brak sięgają 20 mln euro. Oto praktyczny przewodnik.

Co to jest DPIA?

DPIA (art. 35 RODO) to systematyczna ocena ryzyka dla praw i wolności osób, których dane przetwarzasz. Dokument zawiera:

- Opis przetwarzania

- Cel i podstawa prawna

- Ocena konieczności i proporcjonalności

- Identyfikacja ryzyk

- Środki minimalizujące ryzyka

- Stanowisko Inspektora Ochrony Danych (jeśli wyznaczony)

Kiedy DPIA jest obowiązkowa dla AI?

Zgodnie z RODO + wytycznymi EDPB + AI Act:

1. Systematyczna ocena osób na dużą skalę

Przykłady AI:

- Automatyczny scoring kandydatów do pracy

- AI ocenające wyniki pracowników

- Chatboty tworzące profile psychologiczne klientów

2. Monitorowanie zachowań na dużą skalę

Przykłady:

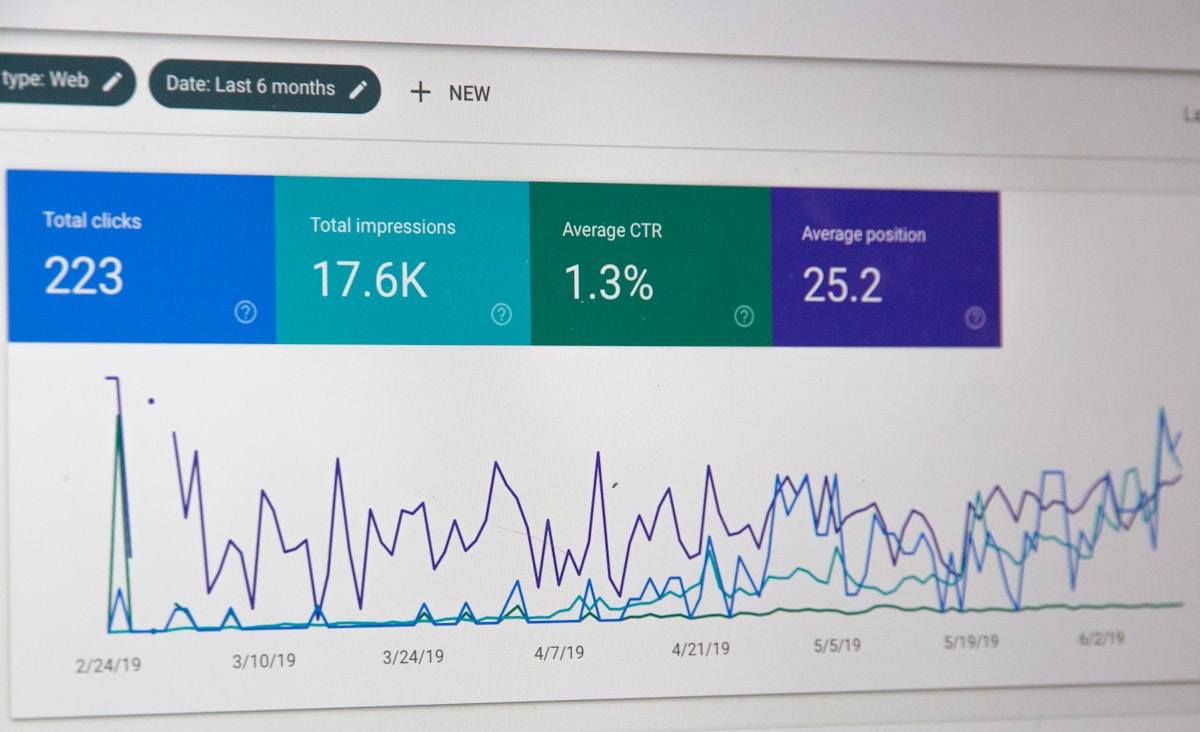

- Analiza zachowania użytkowników na stronie (dla większych sklepów)

- Monitoring pracy (kamery z AI)

- Analytics z personalizacją

3. Przetwarzanie danych wrażliwych

Dane wrażliwe w RODO:

- Zdrowie

- Pochodzenie etniczne

- Przekonania polityczne/religijne

- Orientacja seksualna

- Dane biometryczne

- Dane genetyczne

AI analizujące CV pod kątem zdrowia = obowiązkowa DPIA.

4. Technologie innowacyjne

AI, ML, deep learning to definicyjnie "nowe technologie" — UODO zaleca DPIA nawet przy niższej skali.

5. Systemy wysokiego ryzyka wg AI Act

Automatyczna lista DPIA:

- HR (rekrutacja, ewaluacja)

- Edukacja (oceny, dostęp)

- Zdrowie (diagnostyka)

- Finanse (scoring kredytowy)

- Administracja (świadczenia)

- Sądownictwo

6. Lista UODO

UODO publikuje w Polsce listę operacji wymagających DPIA. Aktualna (2024): 19 kategorii, w tym wiele związanych z AI.

Kiedy DPIA NIE jest obowiązkowa?

- AI do zadań wewnętrznych bez danych osobowych (np. tworzenie kodu)

- Narzędzia nie przetwarzające danych polskich użytkowników

- Chatbot bez personalizacji (FAQ bot)

- Automatyzacja czysto techniczna (spam filter)

Zasada: jeśli nie wiesz, czy potrzebujesz — zrób DPIA. Koszt: 1-2 dni, korzyść: ochrona przed karami.

Struktura DPIA — 7 sekcji

Sekcja 1: Opis przetwarzania

- Czego dotyczy (nazwa systemu, funkcja)

- Kategorie osób (klienci, pracownicy, kandydaci)

- Kategorie danych (imię, email, CV, zachowanie)

- Okres przetwarzania

- Odbiorcy danych

Sekcja 2: Cel i podstawa prawna

- Dlaczego używasz AI (konkretny cel biznesowy)

- Podstawa prawna (zgoda, umowa, uzasadniony interes)

- Jeśli uzasadniony interes — test trzyczęściowy

Sekcja 3: Konieczność i proporcjonalność

- Czy cel dałoby się osiągnąć mniej inwazyjnie?

- Czy skala jest proporcjonalna?

- Alternatywy rozważone

Sekcja 4: Ryzyka dla osób

Typowe dla AI:

- Dyskryminacja (bias w modelu)

- Błędne decyzje (halucynacje)

- Naruszenie prywatności

- Utrata kontroli nad danymi

- Wyciek danych

Dla każdego ryzyka: prawdopodobieństwo × dotkliwość = poziom.

Sekcja 5: Środki minimalizujące

- Pseudonimizacja / anonimizacja

- Nadzór człowieka

- Ograniczenie dostępu

- Audyt modelu (bias testing)

- Szkolenia pracowników

- Procedury reakcji na incydenty

Sekcja 6: Konsultacje

- Z IOD (obowiązkowe)

- Z osobami, których dane dotyczą (zalecane)

- Z UODO (jeśli ryzyko wysokie)

Sekcja 7: Decyzja

- Czy kontynuować? (Tak / Nie / Ze zmianami)

- Kto zatwierdził

- Data, podpis

- Harmonogram przeglądu (zwykle rocznie)

Przykład DPIA — AI do screeningu CV

Sekcja 1: Opis

- System: "ATS Pro" z modułem AI

- Przetwarzamy: CV kandydatów (imię, email, doświadczenie, wykształcenie)

- Cel: selekcja 5 najbardziej pasujących kandydatów z 100 aplikacji

- Podstawa: uzasadniony interes (efektywność procesu rekrutacji)

Sekcja 4: Ryzyka

- Dyskryminacja (wysokie): model może preferować niektóre grupy

- Błąd w przypisywaniu (średnie): kandydat odrzucony mimo dopasowania

- Wyciek danych (niskie): zabezpieczenia dostawcy sprawdzone

Sekcja 5: Środki

- Obowiązkowy review każdej decyzji przez rekrutera (nadzór człowieka)

- Bias testing co kwartał

- Informacja dla kandydatów o użyciu AI

- Prawo do zakwestionowania decyzji

Sekcja 7: Decyzja

- Kontynuować, ale z comiesięcznym przeglądem

- Zatwierdziła: IOD + CEO

- Przegląd: co kwartał

Kto wykonuje DPIA?

- Mała firma: właściciel + prawnik/IOD zewnętrzny

- Średnia firma: IOD wewnętrzny + compliance

- Duża firma: dedykowany zespół compliance AI

Koszt zewnętrzny: 3 000 - 15 000 zł za DPIA.

Co po DPIA?

- Przechowuj — minimum 5 lat (często cały okres przetwarzania)

- Aktualizuj — gdy zmieniają się parametry systemu

- Udostępnij UODO — na żądanie

- Użyj jako dowód — w razie kontroli

Kary za brak DPIA

- RODO art. 83 ust. 4: do 10 mln euro lub 2% obrotu

- W praktyce w Polsce: 50 000 - 2 000 000 zł (2024-2025)

FAQ

Czy ChatGPT wymaga DPIA u klienta? Jeśli klient wrzuca tam dane swoich użytkowników — tak, zalecane.

Kto jest odpowiedzialny za DPIA — firma czy dostawca AI? Firma (administrator danych). Dostawca AI jest procesorem.

Czy jedna DPIA może pokrywać wiele systemów? Tak, jeśli są podobne (np. kilka chatbotów). Różne systemy = różne DPIA.

Czy DPIA musi być zatwierdzona przez UODO? Nie — tylko konsultacja w przypadku wysokiego ryzyka.

Czy można wycofać DPIA, jeśli ryzyko się zmniejszy? Aktualizujesz DPIA z nową oceną. Nie usuwasz starej.

Podsumowanie

DPIA to jedna z najważniejszych inwestycji compliance dla firm używających AI. Koszt wykonania: 3-15 tys. zł. Koszt braku: do 10 mln euro + reputacja. Jeśli chcesz systematycznie zrozumieć RODO i AI Act w polskiej firmie, sprawdź kurs RODO i AI.